En Resumen

- Stability AI lanzó Stable Diffusion 3 (SD3), el generador de texto a imagen más potente, bajo licencia gratuita no comercial.

- SD3 Medium, con 2 mil millones de parámetros, es ideal para PCs y laptops, ofreciendo generaciones realistas y detalladas.

- La colaboración con Nvidia mejoró el rendimiento; con requisitos de hardware que van desde 5GB a 16GB de VRAM, dependiendo del modelo y tamaño.

Stability AI, una empresa líder en el campo de la inteligencia artificial, acaba de lanzar la última generación de su generador de imágenes de código abierto, Stable Diffusion 3 (SD3). Este modelo es el generador de texto a imagen de código abierto y personalizable más potente hasta la fecha.

SD3l se lanzó bajo una licencia gratuita no comercial y está disponible a través de Hugging Face. También está disponible en la API y aplicaciones de Stability AI, incluidas Stable Assistant y Stable Artisan. Se anima a los usuarios comerciales a contactar a Stability AI para conocer los detalles de la licencia.

"Stable Diffusion 3 Medium es el modelo abierto de texto a imagen más avanzado de Stability AI hasta la fecha, que comprende dos mil millones de parámetros", señaló Stability AI en un comunicado oficial, "el tamaño más pequeño de este modelo lo hace perfecto para ejecutarse en PCs y laptops de consumidores, así como en GPUs de nivel empresarial. Tiene un tamaño adecuado para convertirse en el próximo estándar en modelos de texto a imagen."

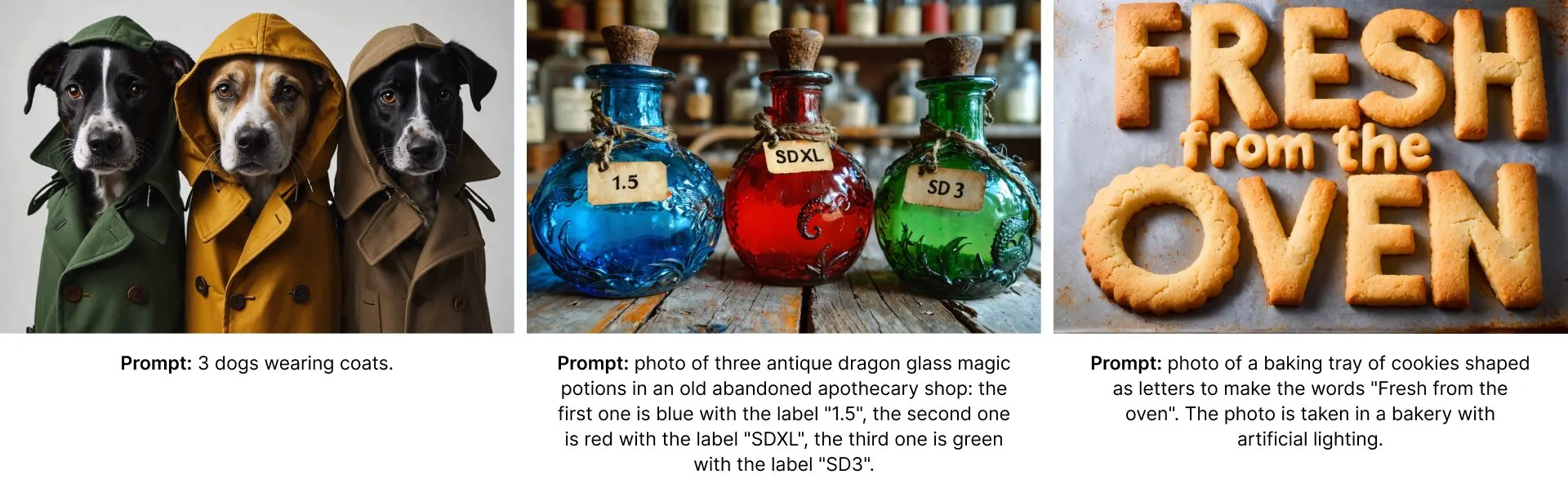

Decrypt tuvo acceso al modelo y realizó algunas generaciones de prueba. Los flujos de trabajo habituales de ComfyUI compatibles con SD1.5 y SDXL no funcionan con SD3. En este momento, la forma más fácil de ejecutarlo es a través de StableSwarmUI. Hay una publicación en Reddit que explica cómo hacerlo.

Las primeras generaciones fueron realmente buenas, incluso para el modelo más pequeño. Los resultados parecían bastante realistas y detallados, claramente superiores a los del SDXL original y comparables a los puntos de control personalizados más recientes del SDXL.

Really enjoying the new SD3. Running it on my potato-ish RTX2060 GPT with 6GB of vRAM. Around 45 seconds per generation vs 30 of SDXL.https://t.co/t2RZaXNSVu pic.twitter.com/mPJAQRZubA

— jaldps (@jaldpsd) June 12, 2024

Las características clave del modelo incluyen fotorealismo, adherencia rápida, tipografía, eficiencia de recursos y capacidades de ajuste fino. Supera artefactos comunes en manos y caras, entregando imágenes de alta calidad sin necesidad de flujos de trabajo complejos. El modelo también comprende indicaciones complejas que involucran relaciones espaciales, elementos de composición, acciones y estilos. Es notablemente hábil en la generación de texto sin artefactos y errores de ortografía, gracias a la arquitectura de Transformador de Difusión de Stability AI. El modelo es capaz de absorber detalles matizados de conjuntos de datos pequeños, lo que lo hace perfecto para la personalización.

El modelo fue presentado por primera vez en febrero de 2024, y estuvo disponible a través de API en abril de 2024.

Stability AI ha colaborado con Nvidia para mejorar el rendimiento de todos los modelos de Stable Diffusion. Las versiones optimizadas con TensorRT del modelo proporcionarán un rendimiento de primera clase, con optimizaciones anteriores que han dado como resultado un aumento de hasta un 50% en el rendimiento.

Stability AI realizó pruebas internas y externas, así como la implementación de numerosas salvaguardas para evitar el mal uso de SD3 Medium por parte de actores malintencionados.

Según un portavoz de Stability AI, los requisitos mínimos de hardware para ejecutar SD3 van desde 5GB a 16GB de VRAM de GPU, dependiendo del modelo específico y su tamaño. SD3 utiliza una tecnología de codificación diferente en este modelo, por lo que puede generar mejores imágenes y tener una mejor comprensión de las indicaciones de texto. También será capaz de generar texto, pero requerirá grandes cantidades de potencia computacional.

"Para SD3 Medium (2 mil millones de parámetros) recomendamos 16GB de VRAM de GPU para una mayor velocidad, pero las personas con menos VRAM aún pueden ejecutarlo con un mínimo de 5GB de VRAM de GPU," dijo Stability AI a Decrypt. La empresa agregó que, "SD3 tiene una estructura modular, lo que le permite trabajar con los 3 Codificadores de Texto, con versiones más pequeñas de los 3 Codificadores de Texto o solo con un subconjunto de ellos. Gran parte de la VRAM se utiliza para los codificadores de texto.

También existe la posibilidad de ejecutar el codificador de texto más grande, que es T5-XXL, en la CPU. Esto significa que los requisitos mínimos para ejecutar SD3 2B están entre los requisitos de SD1.5 y SDXL. Para el ajuste fino, eso también depende de cómo maneje los Codificadores de Texto. Suponiendo que preprocese su conjunto de datos y luego descargue los codificadores, los requisitos son aproximadamente los mismos que SDXL utilizando el mismo método."

Stability AI agregó que “no hay necesidad de un refinador". Esta característica simplifica el proceso de generación y mejora el rendimiento general del modelo. SDXL introdujo esta característica al lanzar dos modelos que debían ejecutarse uno tras otro. El modelo base generaba la imagen general y el refinador se encargaba de agregar los pequeños detalles. Sin embargo, la comunidad de Stable Diffusion rápidamente abandonó el refinador y ajustó el modelo base, haciéndolo capaz de generar imágenes detalladas por sí solo.

Para ver algunos ejemplos de lo que los modelos personalizados de SDXL son capaces de generar en este momento sin refinadores, tenemos una guía detallada para crear imágenes hiperrealistas.

A pesar de la controversia en torno a las finanzas de la empresa y su futuro, Stability se aseguró de informarnos que este probablemente no será su último rodeo. "Stability está trabajando activamente en mejorar nuestros modelos de imagen y enfocándose en nuestros esfuerzos multimodales en video, audio e idioma", dijo el portavoz.

Más allá de Stable Diffusion, Stability AI ha lanzado modelos de código abierto para video, texto y audio. También cuenta con otras tecnologías de generación de imágenes como Stable Cascade y Deepfloyd IF. Stability AI planea mejorar continuamente SD3 Medium basándose en la retroalimentación de los usuarios.

“Nuestro objetivo es establecer un nuevo estándar para la creatividad en el arte generado por IA y hacer de Stable Diffusion 3 Medium una herramienta vital tanto para profesionales como para aficionados”, dijo Stability AI.