Los desarrolladores de software han adoptado las herramientas de inteligencia artificial con el entusiasmo de niños descubriendo dulces, sin embargo, confían en los resultados tanto como en las promesas de un político.

El Reporte DORA 2025 de Google Cloud, publicado el miércoles, muestra que el 90% de los desarrolladores ahora usa IA en su trabajo diario, en un aumento del 14% respecto al año pasado.

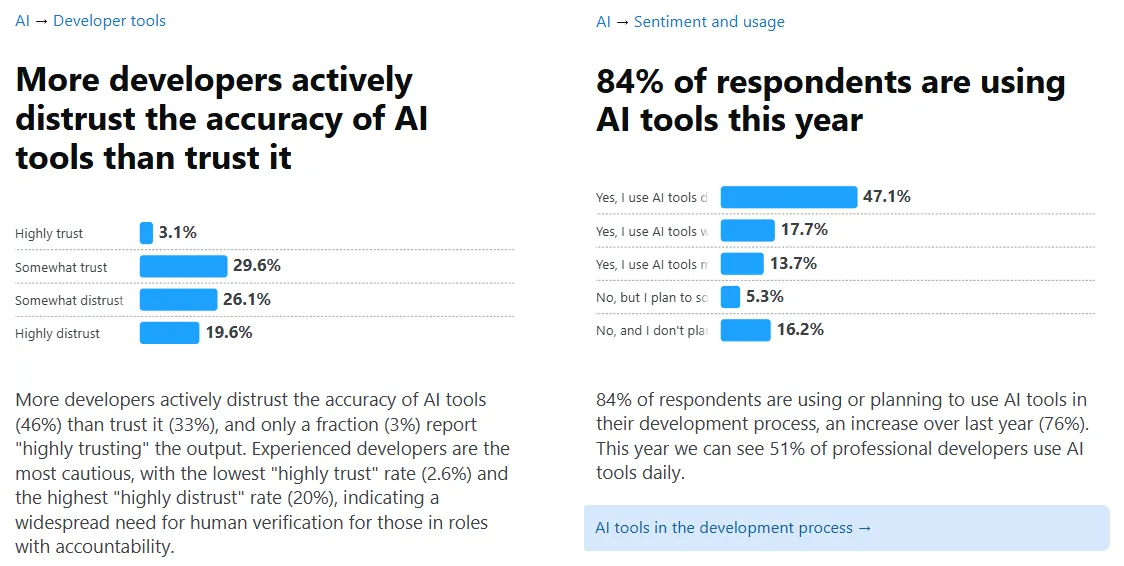

El reporte también encontró que solo el 24% de los encuestados realmente confía en la información que producen estas herramientas.

La investigación anual, que encuestó a casi 5.000 profesionales de tecnología en todo el mundo, pinta un panorama de una industria que está tratando de moverse rápido sin romper las cosas.

Los desarrolladores pasan una mediana de dos horas diarias trabajando con asistentes de IA, integrándolos en todo desde la generación de código hasta revisiones de seguridad. Sin embargo, el 30% de estos mismos profesionales confía en los resultados de la IA "un poco" o "para nada".

"Si eres un ingeniero en Google, es inevitable que uses IA como parte de tu trabajo diario", señaló Ryan Salva, quien supervisa las herramientas de codificación de Google, incluyendo Gemini Code Assist, según dijo a CNN.

Las propias métricas de la empresa muestran que más de una cuarta parte del nuevo código de Google ahora surge de sistemas de IA, con el CEO Sundar Pichai afirmando un aumento de productividad del 10% en los equipos de ingeniería.

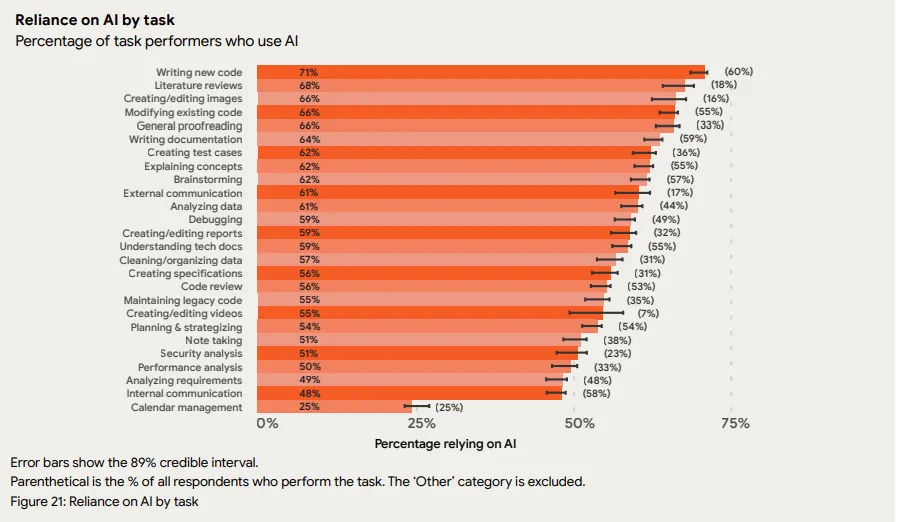

Los desarrolladores usan principalmente la IA para escribir y modificar código nuevo. Otros casos de uso incluyen depuración, revisión y mantenimiento de código heredado junto con propósitos más educativos como explicar conceptos o escribir documentación.

A pesar de la falta de confianza, más del 80% de los desarrolladores encuestados reportó que la IA mejoró su eficiencia en el trabajo, mientras que el 59% notó mejoras en la calidad del código.

Sin embargo, aquí es donde las cosas se vuelven peculiares: el 65% de los encuestados se describió como muy dependiente de estas herramientas, a pesar de no confiar completamente en ellas.

Entre ese grupo, el 37% reportó dependencia "moderada", el 20% dijo "mucho" y el 8% admitió "una gran dependencia".

Esta paradoja de confianza-productividad se alinea con los hallazgos de la encuesta 2025 de Stack Overflow, donde la desconfianza en la precisión de la IA aumentó del 31% al 46% en solo un año, a pesar de las altas tasas de adopción del 84% para el año.

Los desarrolladores tratan a la IA como un compañero de trabajo brillante pero poco confiable—útil para lluvia de ideas y trabajo pesado, pero todo necesita ser verificado dos veces.

DORA: Impulsando Trabajos Nativos de IA

La respuesta de Google involucra más que solo documentar la tendencia.

El martes, la empresa presentó su Modelo de Capacidades de IA DORA, un marco que identifica siete prácticas diseñadas para ayudar a las organizaciones a aprovechar el valor de la IA sin incurrir en riesgos.

El modelo aboga por el diseño centrado en el usuario, protocolos claros de comunicación y lo que Google llama "flujos de trabajo de lotes pequeños"—esencialmente, evitar operaciones de IA sin control ni supervisión.

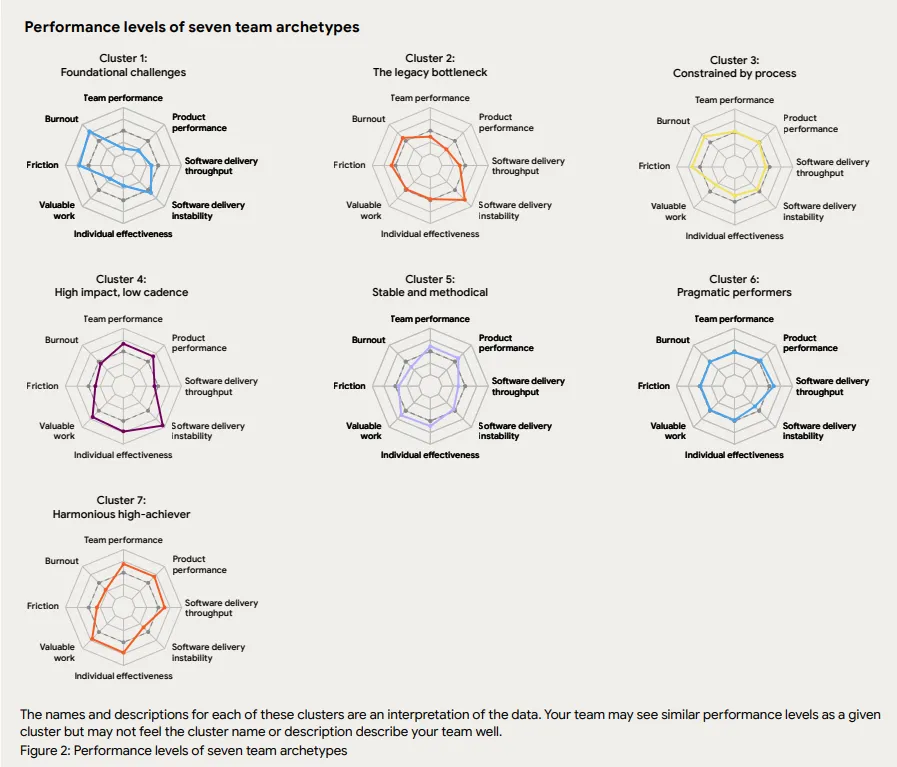

El reporte también introduce arquetipos de equipos que van desde "Triunfadores armoniosos" hasta grupos atascados en un "Cuello de botella heredado".

Estos perfiles surgieron de un análisis de cómo diferentes organizaciones manejan la integración de IA. Los equipos con procesos sólidos existentes vieron a la IA amplificar sus fortalezas. Las organizaciones fragmentadas observaron a la IA exponer cada debilidad en su flujo de trabajo.

El reporte completo del Estado del Desarrollo de Software Asistido por IA y la documentación complementaria del Modelo de Capacidades de IA DORA están disponibles a través del portal de investigación de Google Cloud.

Los materiales incluyen orientación prescriptiva para equipos que buscan ser más proactivos en su adopción de tecnologías de IA—asumiendo que alguien confíe lo suficiente en ellas para implementarlas.