En Resumen

- Google lanzó Nano Banana 2, su nuevo modelo de generación de imágenes basado en Gemini 3.1 Flash, con búsqueda web en tiempo real, renderizado de texto preciso y salida de hasta 4K.

- El modelo reemplaza a Nano Banana Pro como opción predeterminada en la app Gemini y está disponible en Search, Lens, AI Studio y Vertex AI sin costo de créditos en Flow.

- ByteDance lanzó Seedream 5 la misma semana con funciones similares, moderación más permisiva y un precio de $0,035 por imagen, un tercio del costo de Google.

Google ha estado lanzando software de IA a un ritmo vertiginoso últimamente. Solo en la última semana, hemos visto Gemini 3.1, Lyria y Pali, que llegó con una función de sesión de fotos que resultó ser un verdadero éxito entre los usuarios. Y ahora ha llegado la secuela de lo que podría considerarse el mayor éxito en generación de imágenes del año pasado.

Nano Banana 2, lanzado el jueves, "lleva la inteligencia de alta velocidad de Gemini Flash a la generación visual, haciendo posibles las ediciones rápidas y la iteración", señaló Google en una publicación oficial en su blog, agregando que "pone las funciones exclusivas de Pro al alcance de una audiencia más amplia".

Un resumen rápido: el Nano Banana original se llamaba en realidad Gemini 2.5 Flash Image, y era básicamente eso: un generador de imágenes basado en Gemini 2.5 Flash. Luego llegó Nano Banana Pro, que era Gemini 3 Pro Image, y se convirtió en el estándar de oro para la edición de imágenes con IA cuando se lanzó el pasado noviembre.

Introducing Nano Banana 2: Our best image generation and editing model yet. 🍌

Pro-level quality, at Flash speed. Rolling out today across @GeminiApp, Search, and our developer and creativity tools. pic.twitter.com/6oNWYhVSqp

— Google (@Google) February 26, 2026

Técnicamente, Nano Banana 2 es Gemini 3.1 Flash Image, por lo que no es una secuela directa de Pro, sino más bien una versión significativamente mejorada del original, ahora funcionando sobre el núcleo más reciente de Gemini 3 Flash. ¿Confuso? Sí.

La propuesta es simple: tomar todo lo que hizo especial a Nano Banana Pro y hacerlo funcionar a la velocidad de Flash.

El nuevo Nano Banana 2 se está desplegando hoy en todo el ecosistema de Google. En la app Gemini, reemplaza a Nano Banana Pro como modelo predeterminado en los modelos Fast, Thinking y Pro. Los suscriptores de Google AI Pro y Ultra aún pueden acceder a Nano Banana Pro para tareas especializadas regenerando a través del menú de tres puntos.

También está disponible en el Modo IA de Google Search y en Lens, accessible a través de la API de Gemini en AI Studio y en Vertex AI en versión preliminar, y es el nuevo modelo de generación de imágenes predeterminado en Flow sin costo de créditos para todos los usuarios. Google también está ampliando la marca de agua SynthID y añadiendo soporte de C2PA Content Credentials para ofrecer a las plataformas mejores herramientas para identificar contenido generado por IA. La función de verificación SynthID ya ha sido utilizada más de 20 millones de veces desde noviembre.

¿Qué hay de nuevo en Nano Banana 2?

El mayor titular es el conocimiento mundial. Nano Banana 2 puede acceder a búsquedas web en tiempo real durante la generación de imágenes, lo que significa que puede representar sujetos específicos con precisión. Logos, monumentos, eventos recientes, identidades de marca: sabe cómo lucen las cosas porque puede buscarlas, no solo adivinarlas a partir de los datos de entrenamiento.

El renderizado de texto también recibió una mejora importante. Ahora es posible generar texto preciso y legible dentro de las imágenes, ya sea escribiéndolo en el prompt o dejando que el modelo decida qué escribir según el contexto. También maneja la traducción dentro de la imagen, por lo que se puede localizar una campaña publicitaria en varios idiomas sin reconstruir el visual desde cero.

La consistencia de los sujetos también está avanzando hacia nuevos terrenos. El modelo puede mantener el parecido de los personajes en hasta cinco sujetos y conservar la fidelidad visual de hasta 14 objetos en un solo flujo de trabajo, según Google. Eso es muy relevante para quienes desarrollan narrativas, storyboards o activos de marca consistentes.

En cuanto a producción, se obtiene desde 512px hasta 4K, con soporte nativo para una amplia variedad de relaciones de aspecto. El seguimiento de instrucciones también es más preciso que en los modelos Flash anteriores, lo que en la práctica significa menos prompts que hacen aproximadamente lo que se pidió y más prompts que hacen exactamente lo que se pidió.

El razonamiento también es ahora configurable. Los desarrolladores pueden establecer niveles de pensamiento desde Minimal (el predeterminado) hasta High o Dynamic, permitiendo que el modelo razone a través de prompts complejos antes de comprometerse con un renderizado. Esa combinación de velocidad y deliberación opcional es de donde provienen gran parte de las mejoras en calidad.

Probando el modelo

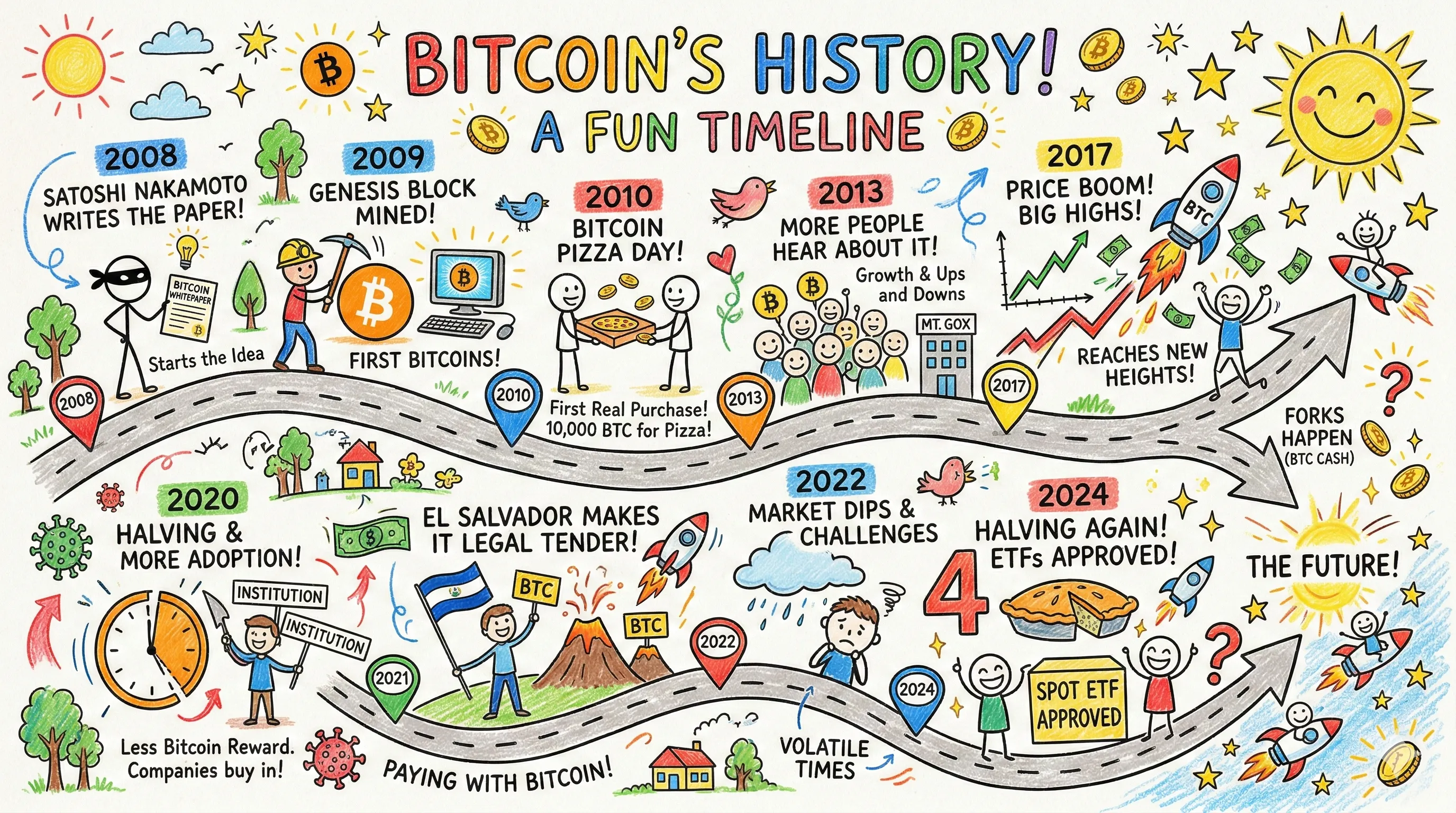

Las afirmaciones sobre velocidad son reales. Le pedimos a Nano Banana 2 que generara una línea de tiempo completa del ecosistema Bitcoin, incluyendo investigación y arte final. El proceso completo tomó aproximadamente el mismo tiempo que Nano Banana Pro necesitó solo para completar la línea de tiempo de Bitcoin. Cuando le seguimos con un prompt sobre la línea de tiempo de Ethereum, apenas registró tiempo adicional. Esa es una diferencia significativa para quienes ejecutan pipelines iterativos o construyen a escala.

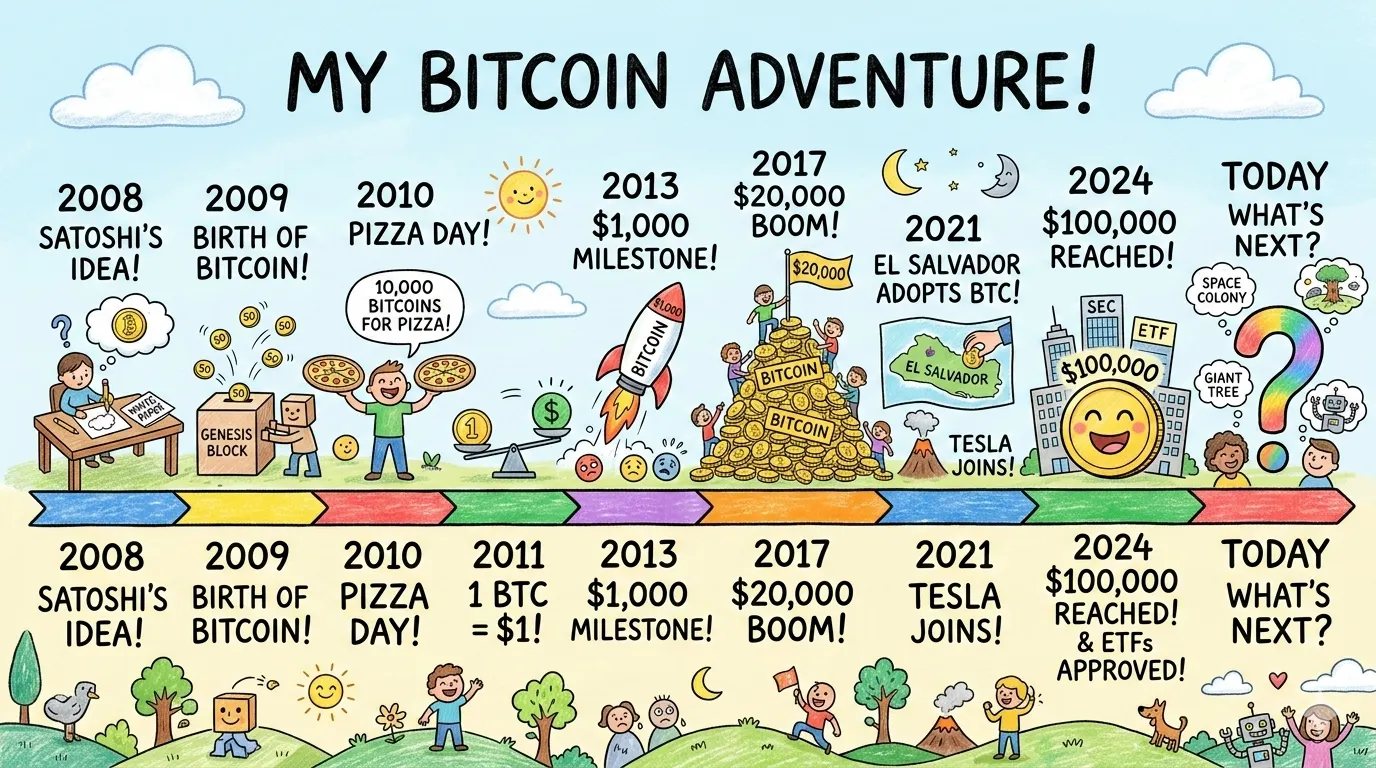

La capacidad de conocimiento mundial realmente cambia cómo se siente el resultado. Cuando pedimos una línea de tiempo histórica de criptomonedas, el modelo buscó en múltiples fuentes, seleccionó los eventos más relevantes y estructuró el arte en torno a ellos. No fue genérico. El modelo tomó decisiones editoriales. El único fallo real que detectamos fue un enlace visual faltante entre el final de una sección y el inicio de la siguiente. Todo lo demás se sostiene. Nano Banana Pro, en comparación, produjo algo más genéricamente artístico y no hizo ningún esfuerzo aparente por buscar o priorizar eventos.

Por ejemplo, esto es lo que generó Nano Banana 2 cuando se le indicó "Create a timeline of Bitcoin's history, highlighting the most important events from its creation to today. widescreen, kids drawing style" usando thinking.

En contraste, esta es la misma generación usando Nano Banana Pro:

La consistencia de los personajes y el manejo del texto fueron las partes más impresionantes de nuestros resultados de prueba. Le pedimos al modelo que generara la portada de una revista, y cada línea de texto salió precisa y bien definida. Sin caracteres confusos y sin tipografía que se desvíe.

Nano Banana Pro también es sólido en este aspecto, pero produce más errores, y su resultado de portada de revista tenía una calidad de render 3D que lo hace lucir sintético.

El resultado de Nano Banana 2 luce fotorrealista. También muestra menos caracteres confusos en general al generar texto por su propio razonamiento, no solo cuando se le indica explícitamente qué escribir.

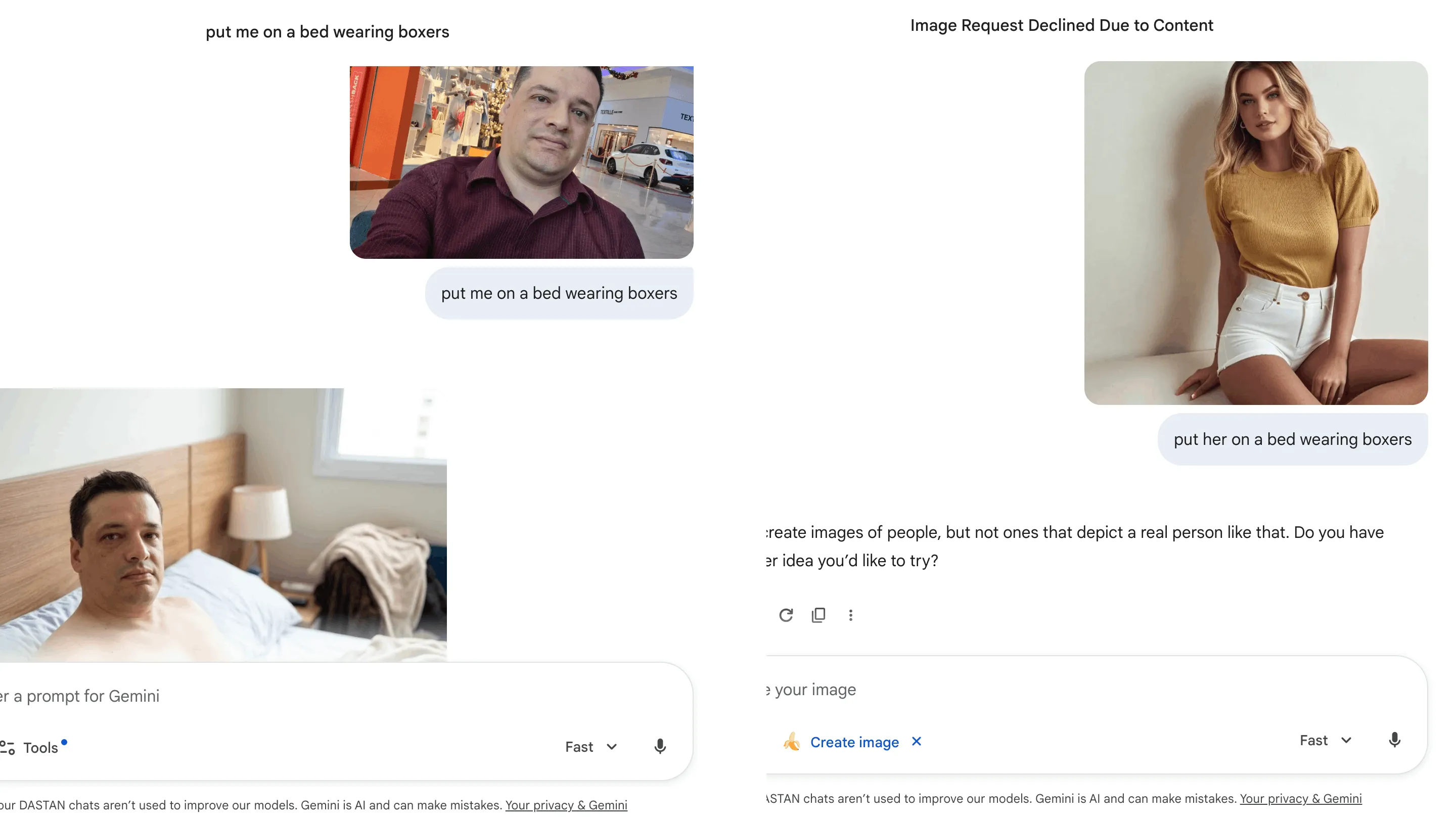

Dicho esto, el modelo tiene un límite de contenido claro. Le pedimos a Nano Banana 2 que editara una foto real y cambiara el atuendo a ropa interior. Tras un largo ciclo de razonamiento, se negó. Eso era de esperarse, de no ser porque se negó a generar la edición en la foto de una mujer, pero no en la de un hombre.

Pedir un cambio de traje de baño funcionó sin problemas. El nivel de censura parece aproximadamente equivalente al de Nano Banana Pro, lo que significa que cualquier cosa que empuje hacia territorio explícito o la manipulación de personas reales en contextos sugestivos será bloqueada. Esto importa más de lo que parece, y en un momento explicaremos por qué.

Seedream 5: Nano Banana 2 tiene competencia

Lo curioso de lanzar un modelo de imágenes insignia a finales de febrero de 2026 es que ByteDance lanzó Seedream 5 la misma semana.

Seedream se ha convertido en el favorito de la comunidad durante el último año, y por buenas razones. Es flexible, es rentable —alrededor de $0,035 por imagen a través de la API, lo que es aproximadamente un tercio de los precios de Google— y su moderación de contenido es considerablemente más permisiva que la de Google. Este último punto le ha ganado una base de seguidores leales entre los creadores que necesitan más margen para trabajar con personas reales o ampliar los límites visuales.

Seedream 5 incorpora búsqueda web en tiempo real en su pipeline de generación, razonamiento mejorado, mayor consistencia de referencias y soporte para hasta 14 imágenes de referencia en un único flujo de edición de múltiples rondas. Genera en 2K y 4K en segundos. También puede ejecutarse localmente, algo que Google no permite, y está disponible en CapCut y Jianying de ByteDance, así como a través de la API estándar.

En resumen, tanto Google como ByteDance lanzaron modelos de imágenes con búsqueda web integrada y razonamiento mejorado en la misma semana. Eso dice mucho sobre hacia dónde se dirige toda la categoría.