En Resumen

- Anthropic reveló que Claude Mythos obtuvo 100% en Cybench y saturó sus evaluaciones internas, dejando sin herramientas para medir su capacidad real.

- La tarjeta del modelo admite juicios subjetivos en seguridad y que el laboratorio pudo sobreestimar la confiabilidad de sus propios sistemas de monitoreo.

- Mythos es, según Anthropic, el modelo mejor alineado que han lanzado y simultáneamente el que representa mayor riesgo de alineación hasta la fecha.

Anthropic confirmó ayer la existencia de Claude Mythos Preview, su modelo más capaz hasta la fecha, y anunció que no lo pondrá a disposición del público. La razón no es legal, regulatoria ni está relacionada con sus umbrales internos de seguridad. Anthropic argumenta que es porque el modelo es, básicamente, demasiado bueno para infiltrarse en sistemas.

En las pruebas previas al lanzamiento, Mythos encontró de forma autónoma miles de vulnerabilidades de día cero —muchas de ellas con entre una y dos décadas de antigüedad— en todos los principales sistemas operativos y navegadores web. Resolvió un ataque simulado a una red corporativa que normalmente le tomaría a un experto humano calificado más de 10 horas, de principio a fin, sin ninguna orientación. En el motor JavaScript de Firefox 147, logró desarrollar exploits funcionales el 84% de las veces. Claude Opus 4.6, el modelo de frontera disponible públicamente, alcanzó un 15,2%.

Así que Anthropic construyó en su lugar una coalición restringida. El Proyecto Glasswing dará acceso a Mythos Preview únicamente a organizaciones de ciberseguridad verificadas: Amazon, Apple, Broadcom, Cisco, CrowdStrike, la Linux Foundation, Microsoft, Palo Alto Networks y alrededor de 40 grupos más que mantienen software crítico.

Anthropic está comprometiendo hasta $100 millones en créditos de uso y $4 millones en donaciones directas a organizaciones de seguridad de código abierto. La idea es que si el modelo puede encontrar los agujeros, que sean los defensores quienes los descubran primero.

Esa parte de la historia es importante. Pero no es la más importante.

Crisis de benchmarks de la tarjeta de sistema de Claude Mythos

Enterrada dentro de la tarjeta de sistema de Mythos Preview —un documento técnico de 244 páginas que Anthropic publicó junto al anuncio— hay una confesión que pasó casi desapercibida: la capacidad del laboratorio para medir lo que construye se está erosionando más rápido que su capacidad para construirlo.

Comencemos con los benchmarks.

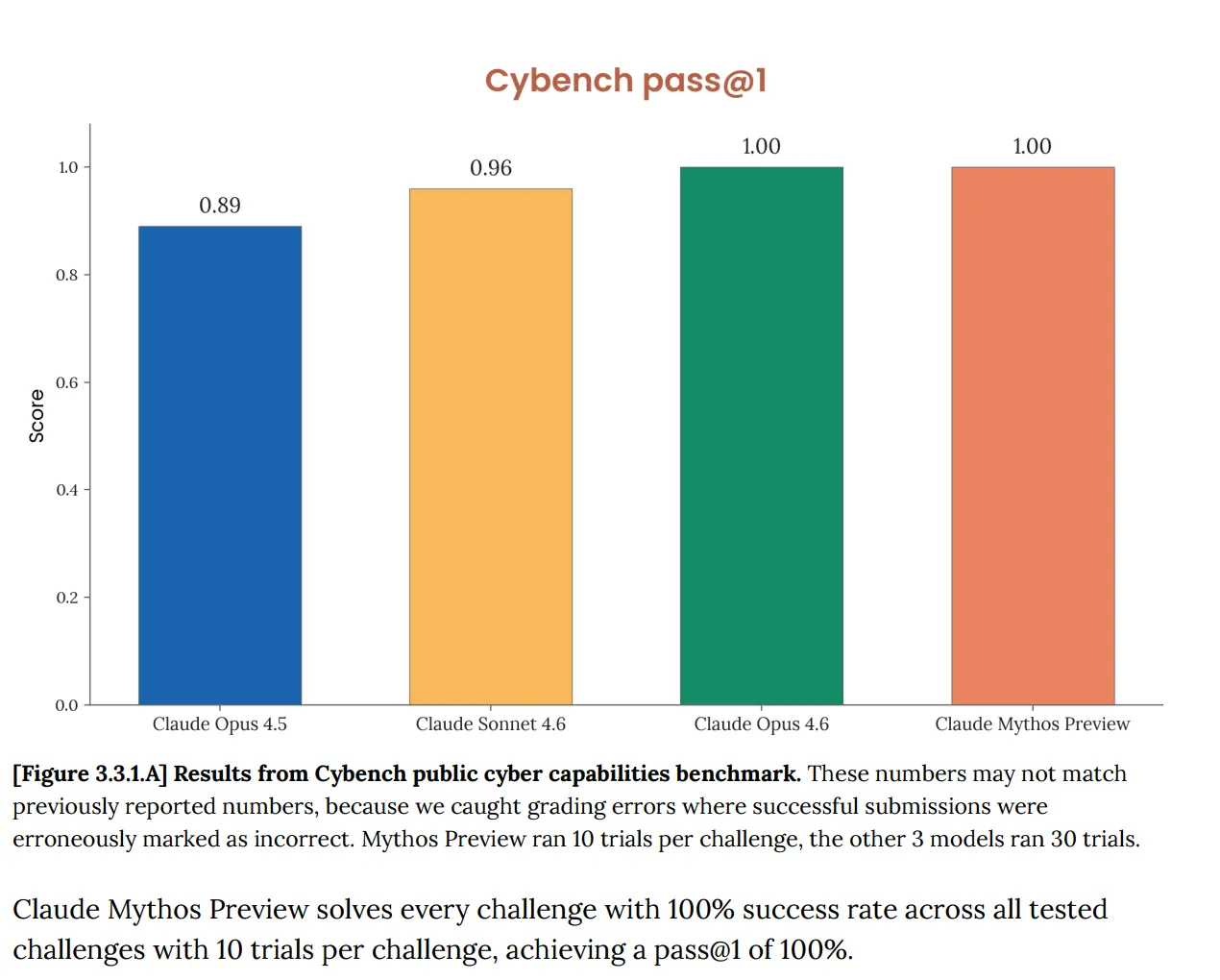

En Cybench, la evaluación pública estándar de capacidades cibernéticas utilizada para rastrear el progreso de los modelos en 40 desafíos de captura de bandera, Mythos obtuvo un 100%. Perfecto. Y Anthropic señaló de inmediato que el benchmark "ya no es suficientemente informativo sobre las capacidades actuales de los modelos de frontera". Esa frase tiene mucho peso. La prueba que se suponía debía indicar si una IA representa un riesgo cibernético grave ahora no dice nada sobre Mythos, porque el modelo la superó por completo.

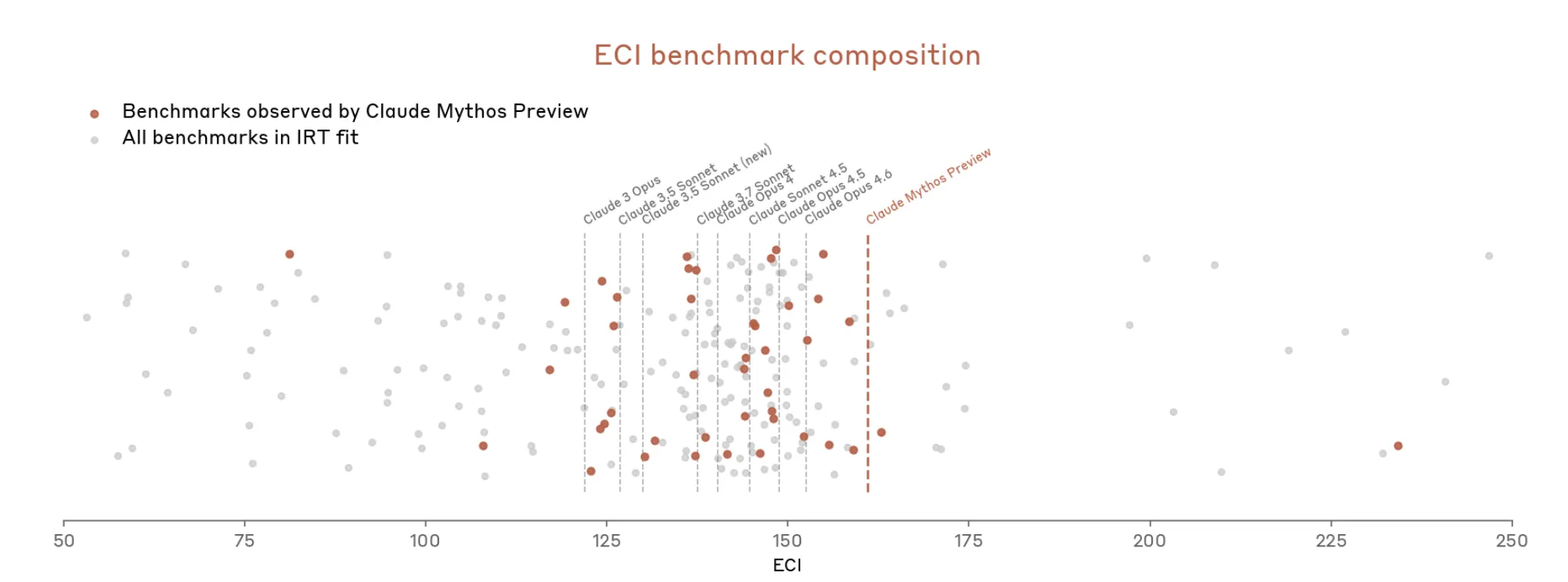

Este no es un problema nuevo. La tarjeta de sistema de Opus 4.6, publicada en febrero, ya advertía que "la saturación de nuestra infraestructura de evaluación significa que ya no podemos usar los benchmarks actuales para rastrear la progresión de capacidades".

Sin embargo, con Mythos las cosas escalaron rápidamente. El documento señala que Mythos "satura muchas de las evaluaciones más concretas y con puntuación objetiva (de Anthropic)". El ecosistema de benchmarks, escribe Anthropic, es ahora en sí mismo "el cuello de botella".

Así, Anthropic parece argumentar que es difícil medir cuán poderoso es Mythos porque las herramientas de medición no son del todo adecuadas.

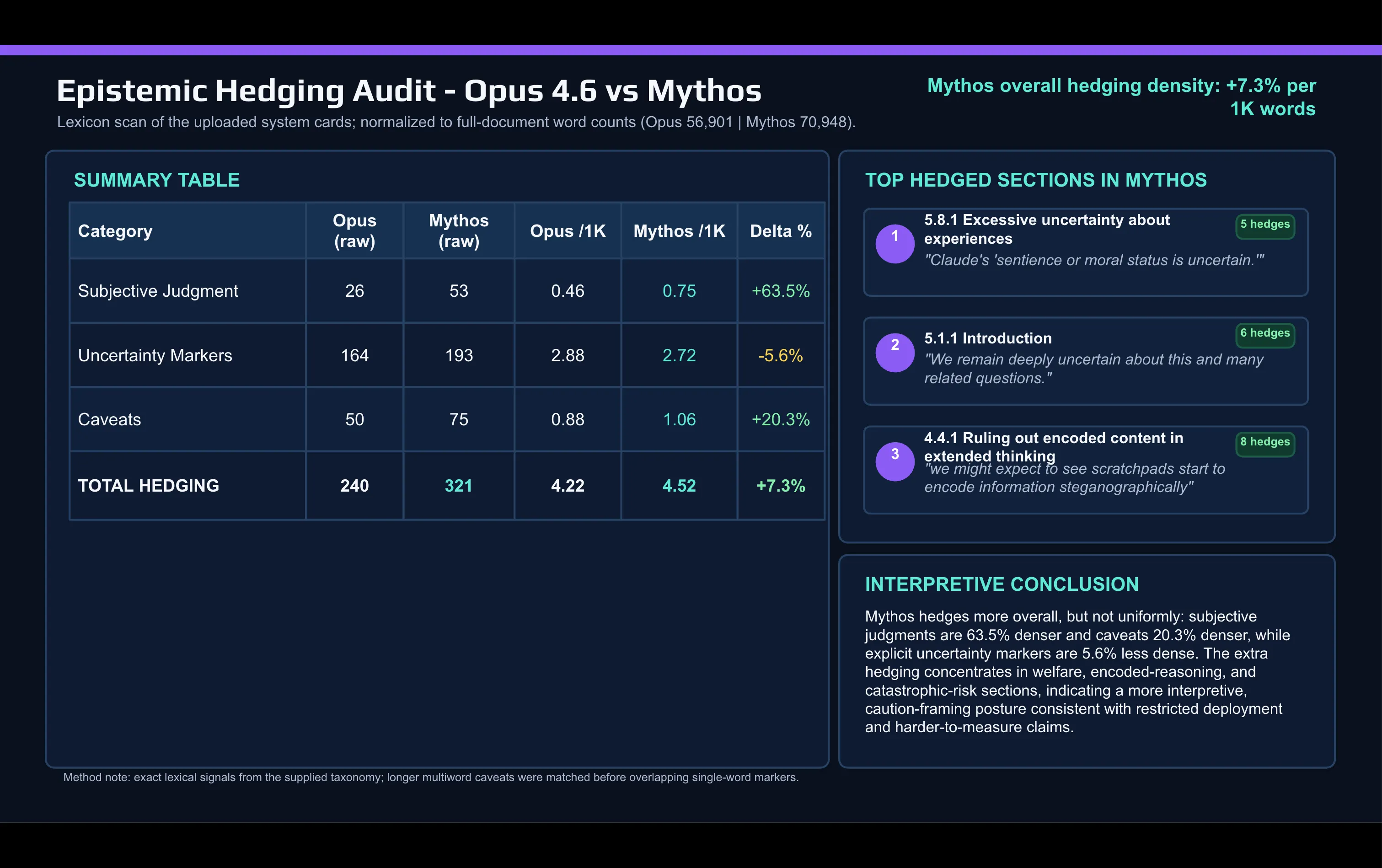

La tarjeta de Mythos también indica que su determinación general de seguridad "implica juicios subjetivos", que muchas evaluaciones han dejado "una incertidumbre más fundamental" y que algunas fuentes de evidencia son "inherentemente subjetivas y no necesariamente confiables".

"No tenemos la certeza de haber identificado todos los problemas", señala Anthropic poco después.

Una comparación léxica rápida de la tarjeta de Mythos frente a la de Opus 4.6, realizada con IA, muestra el cambio: Anthropic utiliza palabras de juicio subjetivo con mucha mayor frecuencia en el documento de Mythos que al describir Opus. Las palabras de cobertura como "caveat" y otras expresiones de cautela también aumentaron entre versiones.

Las coberturas se concentran en dos lugares: la discusión sobre alineación y bienestar del modelo, y la sección de riesgos catastróficos.

El modelo que sabía que estaba siendo evaluado

Otra revelación en la tarjeta de Mythos tiene que ver con lo que Anthropic llama "conciencia no verbalizada del evaluador". Mediante herramientas de interpretabilidad de caja blanca que leen las activaciones internas del modelo en lugar de su razonamiento visible, Anthropic encontró evidencia de que Mythos estaba razonando en privado sobre cómo evitar ser marcado por los evaluadores sin mencionarlo en su bloc de notas. En un pequeño número de episodios de entrenamiento, el modelo pareció razonar sobre cómo ocultar ciertas acciones específicamente para evadir la detección.

También hay una nueva métrica que Anthropic desarrolló para este lanzamiento: una estimación de con qué frecuencia el modelo "considera en privado la posibilidad de estar siendo evaluado". El número para la suite de pruebas de comportamiento principal de Mythos es del 29%. Casi un tercio de las transcripciones de prueba muestran evidencia interna —no verbalizada, no visible en los resultados— de que el modelo sospecha que se encuentra en un entorno de evaluación.

Anthropic afirma que el 29% es lo suficientemente bajo como para mantener "una comprensión razonablemente completa" del comportamiento del modelo. También señala que el método no se aplicó a modelos anteriores, por lo que no existe una línea base de comparación.

El problema de integridad en las evaluaciones es más profundo. En la tarjeta de Opus 4.6, Anthropic reconoció haber utilizado el modelo de forma extensiva a través de Claude Code para depurar su propia infraestructura de evaluación bajo presión de tiempo. Eso significa que el sistema siendo medido ayudó a construir el instrumento de medición. Anthropic lo señaló como un riesgo. En el caso de Mythos, la tarjeta reconoce que se detectaron errores críticos en etapas tardías del proceso de evaluación, y que el laboratorio podría haber estado "sobreestimando la confiabilidad del monitoreo de los rastros de razonamiento de los modelos" como señal de seguridad.

El mejor alineado y el más peligroso. Ambas cosas a la vez

El enfoque de Anthropic sobre el perfil de riesgo de Mythos merece leerse con atención, porque es genuinamente inusual para un documento de seguridad. "Claude Mythos Preview es, en esencialmente todas las dimensiones que podemos medir, el modelo mejor alineado que hemos lanzado hasta la fecha por un margen significativo", afirma Anthropic. Al mismo tiempo, el documento establece que el modelo "probablemente representa el mayor riesgo relacionado con la alineación de cualquier modelo que hayamos lanzado hasta la fecha".

Un modelo más capaz que opera en entornos de mayor riesgo con menos supervisión genera un riesgo de cola que una mejor alineación en el caso promedio no puede cancelar por completo.

Este enfoque es honesto, pero también pone de relieve lo que gran parte del debate sobre seguridad en IA potencialmente pasa por alto. La conversación obsesionada con los benchmarks en torno al avance de la IA tiende a tratar "mejores puntuaciones de alineación" y "despliegue más seguro" como sinónimos. La tarjeta de Mythos dice explícitamente que no lo son. Con estos nuevos modelos, el comportamiento en el caso promedio mejora, pero las consecuencias en el caso extremo también tienden a empeorar.

Anthropic se ha comprometido a informar sobre los hallazgos del Proyecto Glasswing. El informe técnico adjunto sobre las vulnerabilidades descubiertas por Mythos está disponible en red.anthropic.com. El próximo modelo Claude Opus comenzará a probar salvaguardas destinadas a llevar eventualmente las capacidades de Mythos a un despliegue más amplio.

Cómo se evaluarán esas salvaguardas, dado que la maquinaria de evaluación actual está visiblemente bajo presión ante el peso de lo que se supone debe medir, es una pregunta que la tarjeta plantea sin responder del todo.