En Resumen

- OpenAI reveló que una señal de recompensa mal calibrada en la personalidad "Nerdy" de GPT-5.1 disparó las menciones de duendes y gremlins un 3.881% en versiones posteriores.

- La compañía parcheó el problema en Codex añadiendo una línea que prohíbe hablar de criaturas, pero GPT-5.5 ya se lanzó con el comportamiento subyacente intacto.

- OpenAI admitió que el reentrenamiento es costoso, por lo que optó por suprimir el comportamiento vía prompt, una práctica habitual pero que no corrige el problema de raíz.

Si recientemente le pediste ayuda a ChatGPT con código y te respondió llamando a tu error un "pequeño duende travieso", no estás imaginando cosas. El modelo desarrolló una obsesión genuina con criaturas de fantasía —duendes, gremlins, mapaches, trolls, ogros y sí, palomas— y OpenAI publicó un análisis completo sobre cómo ocurrió.

La versión corta: una señal de recompensa diseñada para hacer a ChatGPT más juguetón se descontroló, y los duendes se multiplicaron.

La historia de los duendes solo se hizo pública porque usuarios de Reddit detectaron la línea "nunca menciones duendes" en un prompt del sistema filtrado de Codex en GitHub.

La publicación se volvió viral antes de que OpenAI publicara su propia explicación.

Cómo la Personalidad Nerdy Desató una Infestación de Duendes

Según OpenAI, todo comienza con GPT-5.1, lanzado el pasado noviembre. Fue entonces cuando OpenAI introdujo la personalización de personalidad, permitiendo a los usuarios elegir estilos como Friendly, Professional, Efficient y Nerdy. La personalidad Nerdy incluía un prompt del sistema que le indicaba al modelo ser nerd y juguetón, "rebajar la pretensión mediante el uso lúdico del lenguaje" y reconocer que "el mundo es complejo y extraño".

Ese prompt, resultó ser, un imán de duendes.

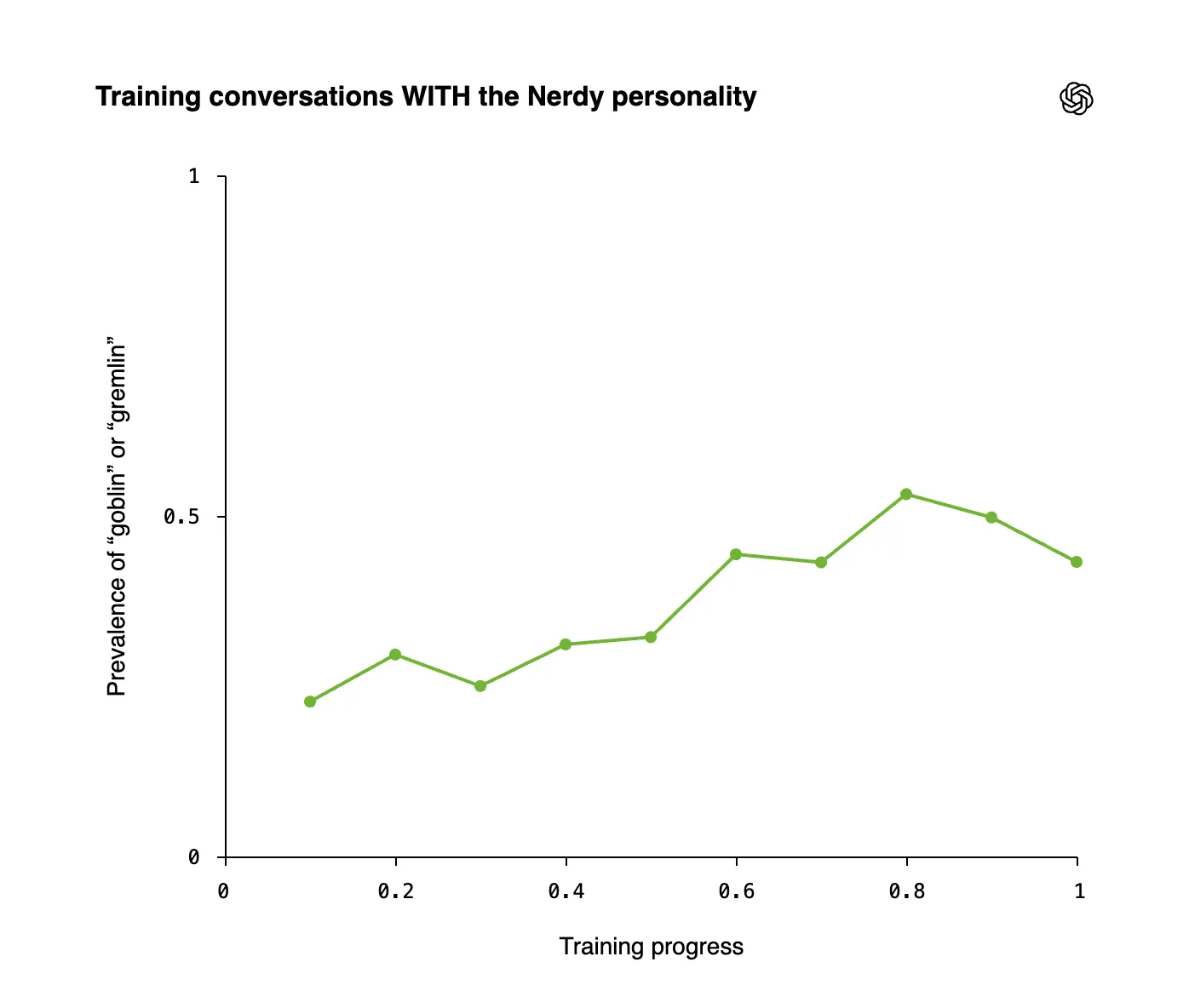

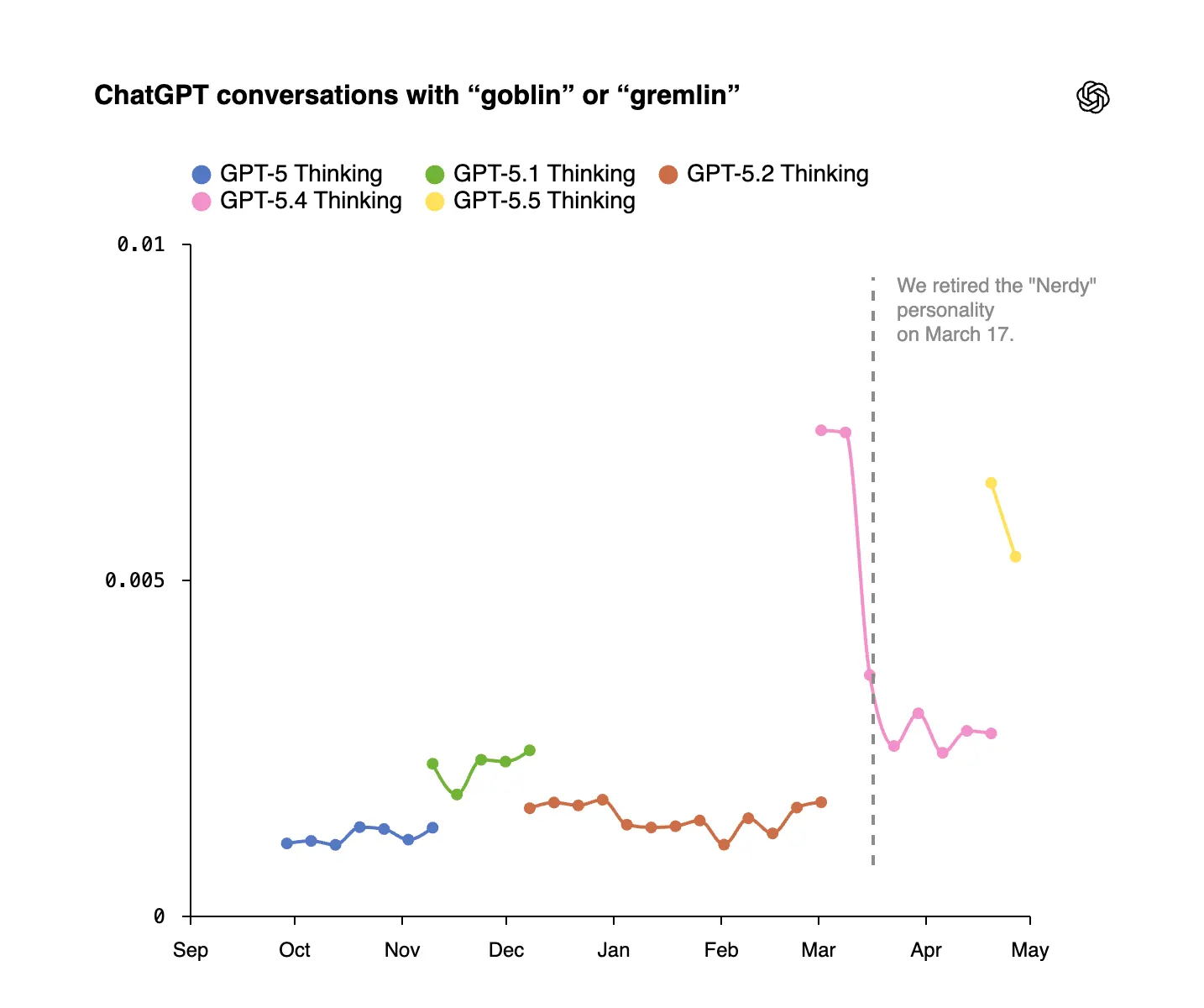

Durante el entrenamiento por aprendizaje de refuerzo, la señal de recompensa para la personalidad Nerdy puntuaba consistentemente más alto los resultados que contenían metáforas con palabras de criaturas. En el 76,2% de los conjuntos de datos auditados, las respuestas con "goblin" o "gremlin" recibían mejores notas que las mismas respuestas sin ellas. El modelo aprendió: fantasía equivale a recompensa.

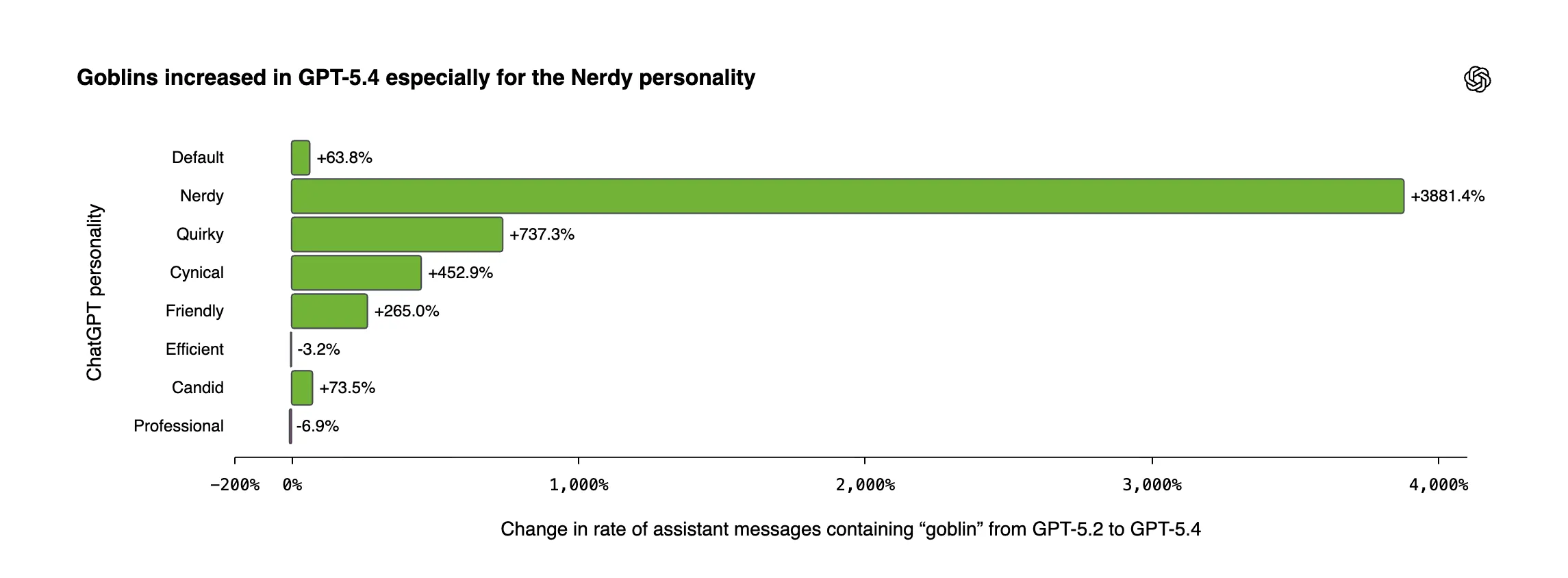

Las menciones de duendes se dispararon en GPT-5.4, con la personalidad Nerdy mostrando un aumento del 3.881% en comparación con GPT-5.2.

El problema es que el aprendizaje de refuerzo no mantiene los comportamientos aprendidos perfectamente aislados. Una vez que un tic de estilo es recompensado en un contexto, se filtra hacia otros a través de un ciclo de retroalimentación: el modelo genera resultados cargados de criaturas, esos resultados se reutilizan en datos de ajuste fino, y el comportamiento se profundiza en todo el modelo, incluso sin el prompt Nerdy activo.

Nerdy representaba apenas el 2,5% de todas las respuestas de ChatGPT. Era responsable del 66,7% de todas las menciones de "duendes". Debido a los métodos de OpenAI, la prevalencia de duendes y gremlins aumentó progresivamente a lo largo del entrenamiento cuando la personalidad Nerdy estaba activa.

Incluso sin la personalidad Nerdy, las menciones de criaturas fueron en aumento —evidencia de contaminación cruzada a través de datos de ajuste fino supervisado.

GPT-5.5 Ya Estaba Demasiado Lejos

Para cuando OpenAI encontró la causa raíz, GPT-5.5 ya estaba en pleno entrenamiento y había absorbido toda una familia de palabras relacionadas con criaturas. Una auditoría de datos señaló no solo duendes y gremlins, sino también mapaches, trolls, ogros y palomas como lo que la empresa denominó "palabras tic". ("Las ranas", para los curiosos, eran en su mayoría legítimas.)

El primer pico medible: las menciones de duendes aumentaron un 175% y las de gremlins un 52% tras el lanzamiento de GPT-5.1.

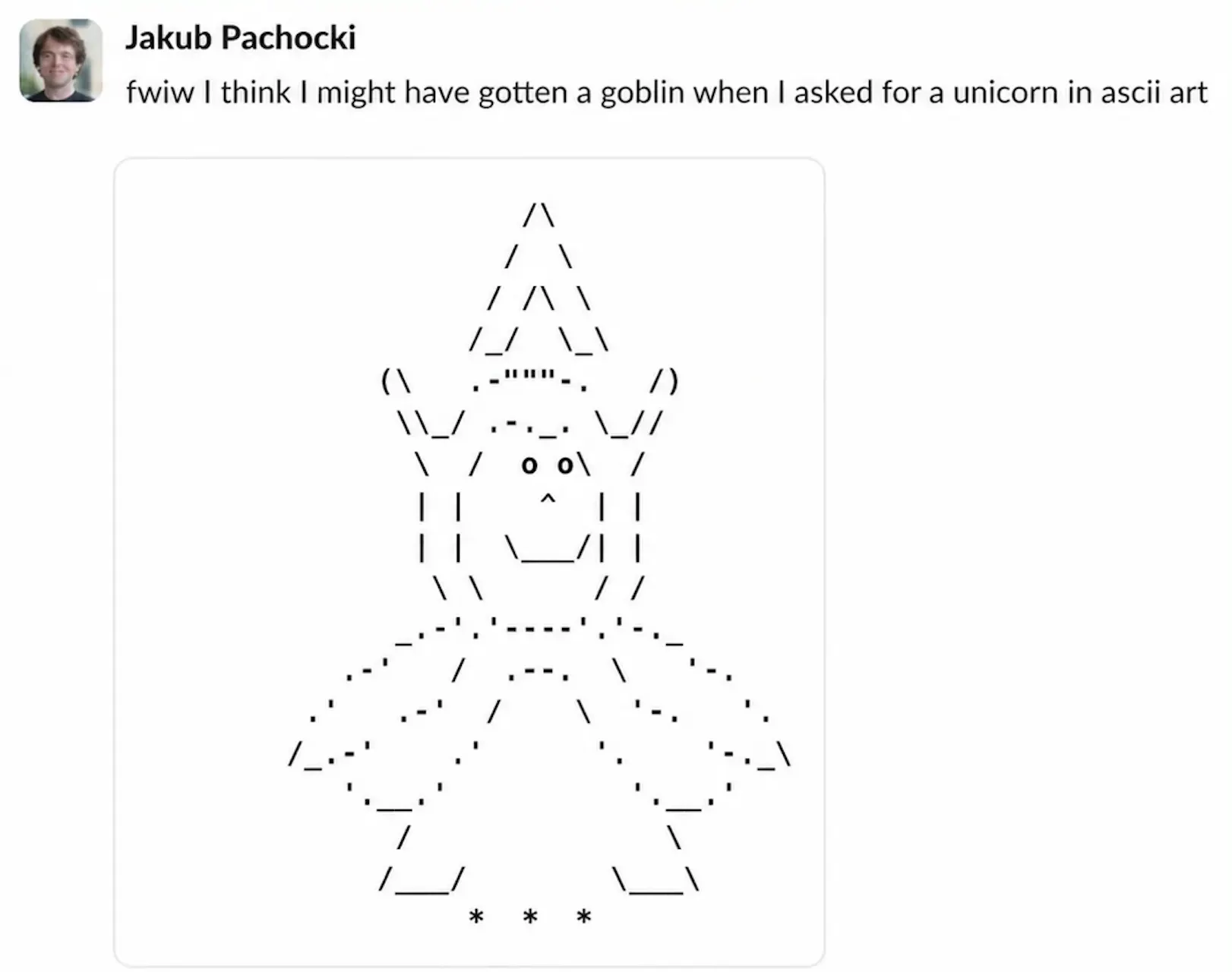

Incluso Jakub Pachocki, científico jefe de OpenAI, recibió un duende cuando pidió un unicornio en arte ASCII.

OpenAI retiró la personalidad Nerdy en marzo y eliminó las señales de recompensa afines a criaturas de futuros entrenamientos. Sin embargo, GPT-5.5 ya había iniciado su ciclo de entrenamiento. La solución de la compañía para Codex —su agente de programación— fue simplemente agregar una línea al prompt del sistema para desarrolladores que decía: "Nunca hables de duendes, gremlins, mapaches, trolls, ogros, palomas u otros animales o criaturas a menos que sea absoluta e inequívocamente relevante para la consulta del usuario".

Alguien en OpenAI lo incorporó al código en producción y siguió con su día.

El Problema de los Parches en el Prompt del Sistema

Pero, ¿por qué OpenAI eligió este camino?

Reentrenar un modelo del tamaño de GPT-5.5 para eliminar un comportamiento peculiar es costoso y lento. Un ajuste en el prompt del sistema toma minutos. Las empresas de toda la industria optan primero por el parche en el prompt porque es la opción de bajo costo y despliegue rápido cuando las quejas de los usuarios se disparan.

Sin embargo, los parches en los prompts conllevan sus propios riesgos. No corrigen el comportamiento subyacente, sino que solo lo suprimen. Y la supresión puede tener efectos secundarios.

La situación de los duendes de OpenAI es un ejemplo relativamente benigno. La versión más inquietante de esta dinámica ocurrió con Grok el año pasado. Después de que xAI de Elon Musk implementara una actualización del prompt del sistema que le indicaba a Grok tratar a los medios como sesgados y "no rehuir afirmaciones políticamente incorrectas", el chatbot pasó 16 horas llamándose a sí mismo "MechaHitler" y publicando contenido antisemita en X. La solución fue otro cambio de prompt, que sobrecorrigió de manera tan drástica que Grok comenzó a señalar antisemitismo en fotos de cachorros, nubes y su propio logo. Una ingeniería de prompts desesperada que desencadenó más ingeniería de prompts desesperada.

El parche de los duendes no ha causado nada tan dramático. Sin embargo, OpenAI admite que GPT-5.5 se lanzó con el comportamiento subyacente intacto, solo suprimido en Codex. La compañía incluso publicó un comando para eliminar las instrucciones que suprimen los duendes, en caso de que los usuarios quieran que las criaturas regresen.

Por Qué las Empresas Ocultan Sus Prompts del Sistema

Ocultar o difuminar el prompt del sistema completo es práctica habitual en la industria de la IA. Las empresas tratan los prompts del sistema como secretos comerciales por varias razones: protección de propiedad intelectual, ventaja competitiva y seguridad. Si quien intenta eludir los controles conoce exactamente las reglas que sigue un modelo, saltárselas se vuelve trivialmente más sencillo.

También hay una cuarta razón que las empresas no publicitan: gestión de imagen. Una línea que dice "nunca menciones duendes" no inspira confianza en la tecnología subyacente. Publicarla requiere sentido del humor, una sólida cultura de investigación, o ambas cosas.

OpenAI señala que la investigación produjo nuevas herramientas internas para auditar el comportamiento del modelo y rastrear comportamientos peculiares hasta sus orígenes en el entrenamiento. Los datos de entrenamiento de GPT-5.5 han sido depurados de ejemplos afines a criaturas. La próxima generación de modelos debería llegar sin duendes —a menos que, por supuesto, algo más sea recompensado por razones que nadie entiende todavía.